SLMとは|デバイスと共に進化するAI

2025-02-27

大規模言語モデル(LLM)が世界的な注目を浴びる一方で、パラメータ数を絞った「小規模言語モデル(SLM)」が存在感を増しています。必要リソースが抑えられるため、省電力・低コストでのAI運用や、クラウドへの依存を避けたい場面でも導入しやすいのが特徴です。

モバイル端末やオンプレミス環境でのローカル推論が想定されており、セキュリティ面から大容量データを外部に出したくない企業にとっても魅力的といえます。本記事では、小規模言語モデルの基礎知識から、活用分野やビジネスにもたらすメリットをわかりやすく解説していきます。

ライター:倉光哲弘

編集:小澤健祐

SLM(Small Language Model)とは何か

SLM(Small Language Model)は、その名の通り、従来の大規模言語モデル(LLM)と比較してパラメータ数が少ない軽量な言語モデルです。この「小ささ」が、ビジネスの現場に革新をもたらす可能性を秘めています。ここでは、SLMの概要や、LLMとの違いについて解説していきます。

SLMの概要

小規模言語モデル(SLM)は、従来の大規模言語モデル(LLM)と比較して、パラメータ数(学習量)が大幅に少ない軽量なAIモデルです。これにより、必要とされる計算リソースが大幅に削減されており、より幅広い環境での活用が可能です。

現在、世界中で大規模言語モデル(LLM)の性能が注目されています。性能を向上させるために、より多くのデータを学習させたり、モデルのパラメータサイズを増やす動きが一般的です。しかし、大規模言語モデルは高コストなどの課題があります。そのような背景から、一部の研究者たちは、SLMという新しいモデルの研究開発を進めています。

<SLMの特徴>

- 軽量設計

SLMはパラメータ数が少なく、リソース消費が少ない点が大きな特徴です。これにより、メモリや計算リソースが限られた環境でも動作します。 - 特定用途に最適化

大規模なモデルとは異なり、SLMは特定のタスクや分野に特化して設計されることが一般的です。このため、目的に応じた高いパフォーマンスを発揮します。 - デプロイの柔軟性

SLMは軽量であるため、エッジデバイス(例:スマートフォンやIoTデバイス)やオンプレミス環境での利用に適しています。クラウドサービスに依存せず、ローカル実行が可能な場合も多いです。 - 低コストで環境負荷が少ない

SLMはトレーニングや推論時に必要な計算資源が少なく、エネルギー消費も抑えられるため、コスト効率が高いだけでなく環境への負荷も軽減します。

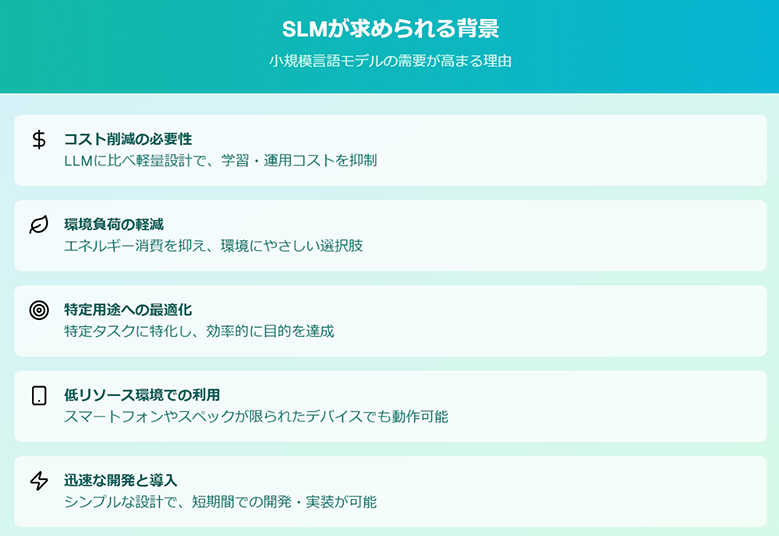

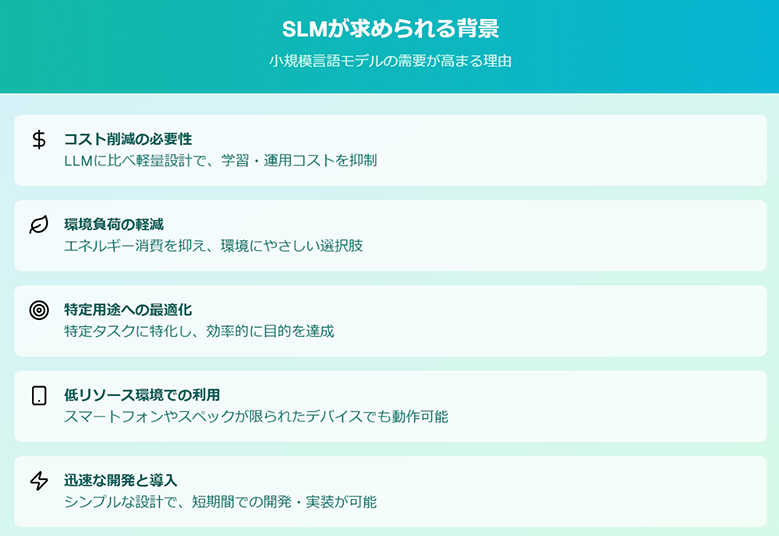

SLMに注目が集まる背景

SLMに注目が集まる背景には、大規模言語モデルが抱える多くの課題があります。先述のように、大規模言語モデルは大規模な計算機リソースや電力を消費し、高いコストがかかります。これによる環境負荷が問題視されるほか、通信状態が整っていない環境や、迅速なレスポンスが求められるシーンでの活用に制限が生じています。

そこで、SLMに注目が集まっているのです。以下がSLMが求められる主な背景です。

<SLMが求められる背景>

- コスト削減の必要性

大規模言語モデル(LLM)は、学習や運用に膨大な計算資源を必要とし、非常に高いコストがかかります。一方、SLMは軽量な設計を目指しているため、コストを抑えられる点が魅力です。 - 環境負荷の軽減

LLMのトレーニングや運用には、大量のエネルギーが必要です。これにより、環境負荷が懸念されています。SLMは軽量なモデルであるため、エネルギー消費を抑え、環境にやさしい選択肢となります。 - 特定用途への最適化

LLMは汎用的な性能を目指していますが、特定のタスクや用途ではその全能力を活かしきれないことがあります。SLMは特定のタスクに特化して設計できるため、効率的に目的を達成できます。 - 低リソース環境での利用

LLMは高性能なハードウェアが必要ですが、SLMはスマートフォンやスペックが限られたデバイスでも動作するように設計されています。これにより、幅広い利用シーンでの適用が期待されています。 - 迅速な開発と導入

大規模モデルは開発に時間と労力がかかりますが、SLMはシンプルである分、比較的短期間で開発・実装が可能です。これにより、技術の実用化が加速します。

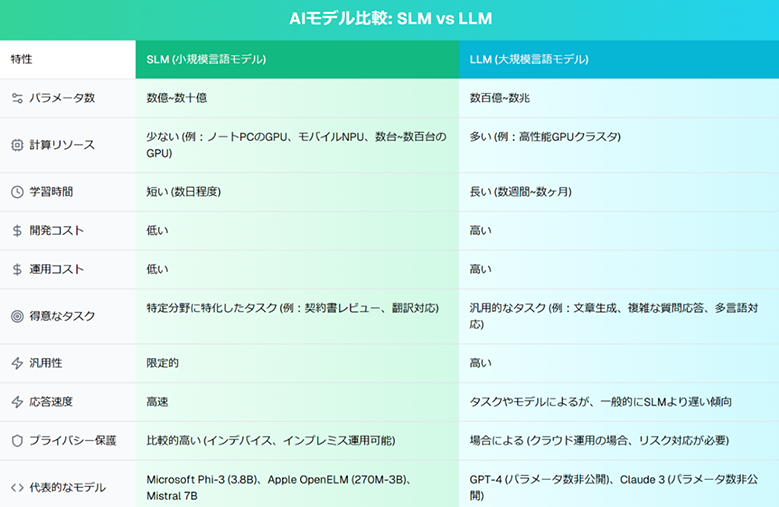

SLMとLLMの違い・使い分け

SLMとLLMは、それぞれ異なる特性を持ち、用途に応じて使い分けることが重要です。ここでは、パラメータ数やハードウェア要件、メリット・デメリットの比較を通じて、両者の違いを明確にし、最適な選択指針を示します。

パラメータ数とハードウェア要件

SLMはパラメータ数が少ないため、コンパクトで導入しやすいAIです。数億~数十億のパラメータ数が一般的で、数百億~数兆のLLMと比べ、必要なハードウェアへの負荷が小さいのが特徴です。

たとえば、MicrosoftのPhi-3-mini(38億パラメータ)は、ノートPCのGPUやモバイル端末でも動作します。

導入ハードルが低く、多くの企業がAI活用の恩恵を受けられ、業務効率化や新たなビジネスチャンス創出が期待できます。

メリット・デメリットの比較

SLMとLLMにはそれぞれ異なる強みがあります。SLMは軽量・低コストで特定タスクに強く、LLMは汎用性と高度な処理能力が魅力です。導入の際は、用途やリソースに応じて最適なモデルを選択することが重要です。本項では、両者の特徴を表で比較し、モデル選択の指針を示します。

用途に応じたモデル選択で、コストと性能のバランスを取れます。

主要ベンダーのSLM実装

各主要ベンダーは、それぞれの強みを活かしたSLMを開発・提供しています。ここでは、Microsoft、Google、Amazonなどの取り組みを紹介し、各社の戦略と製品の特徴を見ていきましょう。これらの情報を参考にすることで、自社に最適なSLMを見つけることができるでしょう。

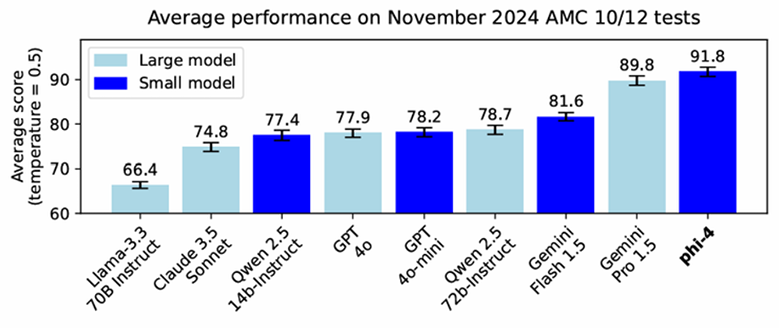

Microsoft(Phi-4など)

Microsoftは、オンプレミスやエッジでの利用を視野に入れた、柔軟性の高いSLM「Phi」シリーズを提供しています。

クラウドとローカル双方の強みを活かす設計で、最新のPhi-4は14億パラメータながら、データ品質とトレーニングの工夫で高い性能を実現しています。

過去モデルのPhi-3では、特定の産業向けにファインチューニングされた事例が報告されています。Phi-4においても、同様に、各企業のニーズに合わせたカスタマイズが施され、業務効率化に貢献することが期待されています。

データ主権やセキュリティを重視する企業でも、自社環境で高速かつ安全なAI運用が可能となり、業務効率化に繋げられるのです。

参考: Microsoft

Google(Gemma / Gemini Nano)

Googleは、軽量デバイスで高度なAI機能を実現する、GemmaとGemini Nanoを提供しています。これらのモデルは、オンデバイス処理に最適化されており、クラウド連携により、さらなる高機能化も可能です。

Gemini Nanoは、1.8B及び3.25Bパラメータの2種類があり、Pixel 8/8 Pro/8a、Pixel 9シリーズ、Samsung Galaxy S24シリーズなどで利用できます。これらのデバイスでは、通話スクリーニング中の応答提案や録音の要約などを、クラウド接続なしで高速に実行できます。

ユーザーは場所や通信環境を問わず、プライバシーが保護された環境で、最先端のAI機能を活用した、効率的で快適な体験を得られるのです。

参考: Google

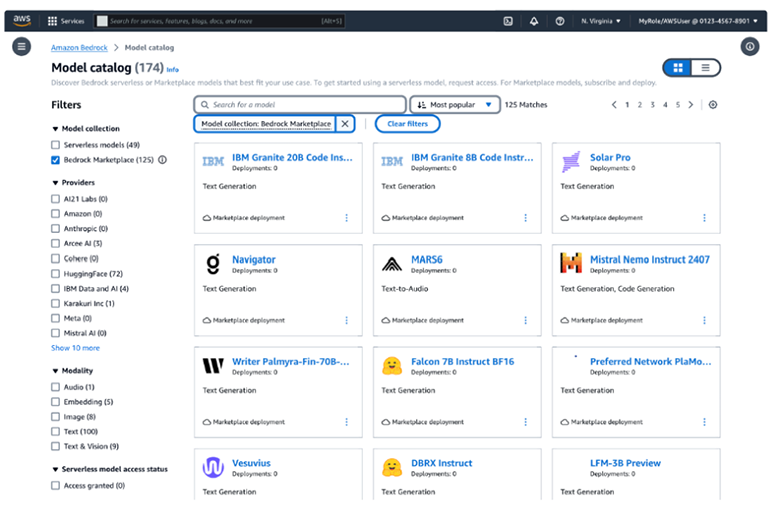

Amazon(Bedrock Marketplace)

Amazon Bedrock Marketplaceは、企業がSLMを含む多様なAIモデルを手軽に導入・運用できる、包括的なプラットフォームです。

100種類以上のモデルから選択でき、特定の業務に最適化されたSLMの迅速なデプロイができます。Arcee AIなどのコンテキスト適応型小規模言語モデルも提供されています。MetaのLlama 3.2 1Bなど、リソースが限られたデバイス向けに最適化されたSLMも利用可能です。

また、標準APIを通じてモデルにアクセスできるため、開発者は容易にアプリケーションに統合できます。

用途に最適なAIモデルを迅速かつ低コストで導入することで、業務の自動化や効率化が期待できます。

参考: Amazon

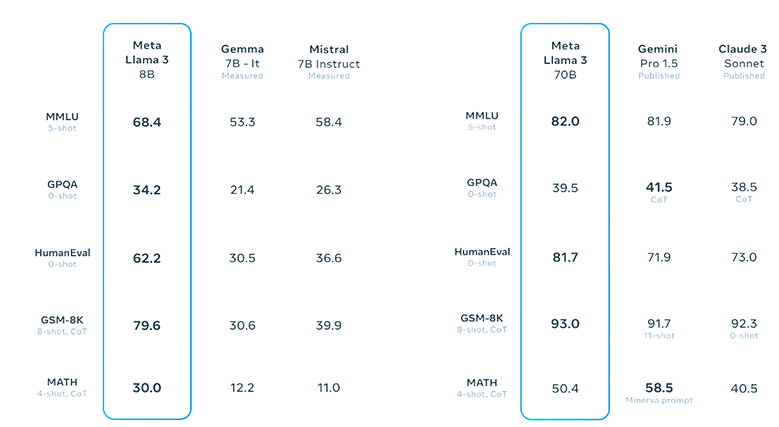

MetaのLlama3

MetaのLlama 3 8Bモデルは、オープンソースの小規模言語モデル(SLM) の中でも、特に性能と柔軟性に優れ、多様な用途に適用できます。

15兆トークンという膨大なデータセットで学習し、前世代モデルから推論能力が大幅に向上しています。

医療分野では患者情報管理システムの効率化、教育分野ではWhatsAppやMessengerと連携したAI学習アシスタントとしての活用が報告されています。また、128Kトークンのコンテキスト長により、より長い文章の理解も可能です。

企業は、Llama 3 8Bモデルを自社向けにカスタマイズし、オンプレミスやクラウド環境で運用することで、業務効率を向上させつつ、AI導入コストを削減できます。

参考: Meta

Mistral AI

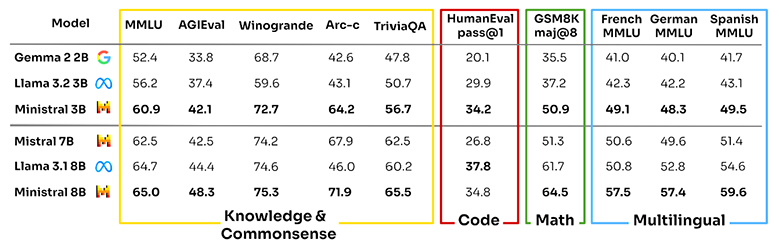

Mistral AIは、高い性能とコスト効率を両立した、オープンソースの小型言語モデル(SLM)で注目を集めています。

主力モデルのMistral 7Bは、同規模のモデルを凌駕する性能を誇り、4ビット量子化技術によりメモリ使用量も削減しています。さらに、より軽量なMinistral 3Bおよび8Bもあります。これらは、最大128kのコンテキスト長に対応し、特にオンデバイスでの利用に最適化されています。

たとえば、Doctolibは医療用語処理にMistralモデルを活用し、高い効果を確認済みです。

Mistral AIのモデルは、企業が高性能なAIを低コストで導入し、業務効率化や迅速な意思決定を実現する強力な選択肢となるでしょう。

参考: Mistral AI

AppleのOpenELM

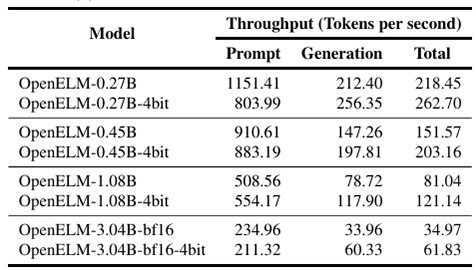

AppleのOpenELMは、エッジデバイス向けに最適化された小規模言語モデル(SLM)です。入力に近いレイヤーでは小さな潜在次元を採用し、出力に近づくにつれて段階的に拡大するスケーリング戦略により、メモリ効率と精度を両立させています。

同規模のOLMoと比較して2倍少ない学習データで2.36%高い精度を達成し、Apple Silicon上でMLXを介した4ビット量子化により256トークン/秒の推論を実現します。

開発者はオンデバイスでのプライバシー保護と高性能な自然言語処理を、効率的な実装で実現できます。

参考: Apple社

SLM導入事例集

実際に、SLMは様々な分野で活用され始めています。ここでは、様々な分野での具体的な導入事例を紹介します。これらの事例から、SLMがどのようにビジネスの課題を解決し、効率化に貢献しているのかを理解できるでしょう。

専門性に特化、精度を極める: ヘッドウォータースのSLMファインチューニング

ヘッドウォータースは、SLMファインチューニングで生成AIの回答精度を向上させるカスタムサービスを展開しています。

RAGだけでは難しい専門用語や社内用語への対応、正答率向上を実現するため、Microsoftの「Phi-3」、Metaの「Llama-3」、OpenAIの「GPT-4o mini」を中心としたSLMを活用中です。

長年の機械学習の知見とKaggleメダリストの技術で、同社は既に実績を挙げています。SLMのファインチューニングによって、製造業や金融業など、高い正答率が求められる業界での導入を進めています。

こうした技術を組み合わせた最先端のソリューションは、業務効率化と競争力強化を強力に後押しするでしょう。

参考: ヘッドウォータース

Epicの医療現場での活用検討――患者履歴要約の効率化

医療ソフト企業EpicはPhi-3を活用して複雑な患者履歴を要約し、医療従事者の負担軽減や素早いレスポンスを実現しています。

大規模言語モデルほどの演算リソースを必要としない小規模モデルであっても、高い推論精度が出せる点に注目しているのです。

院内システムと直接連携して即時要約を行うことで、医療現場における時間とコストの両面でメリットが見込まれます。

参考: Microsoft

Digital Green―Farmer.ChatにPhi-3を搭載し農家を支援

農業支援を行うDigital Greenは、AIアシスタント「Farmer.Chat」にSLMであるPhi-3を統合し、マルチモーダルな会話体験を提供しています。

映像やテキスト情報を組み合わせ、農家の多様な疑問に応答できるのが特長です。

地理的条件や通信状況に左右されず農業コミュニティの生産性を高めるのに貢献しています。

参考: Digital Green

Convirzaが実現したコスト削減と精度向上

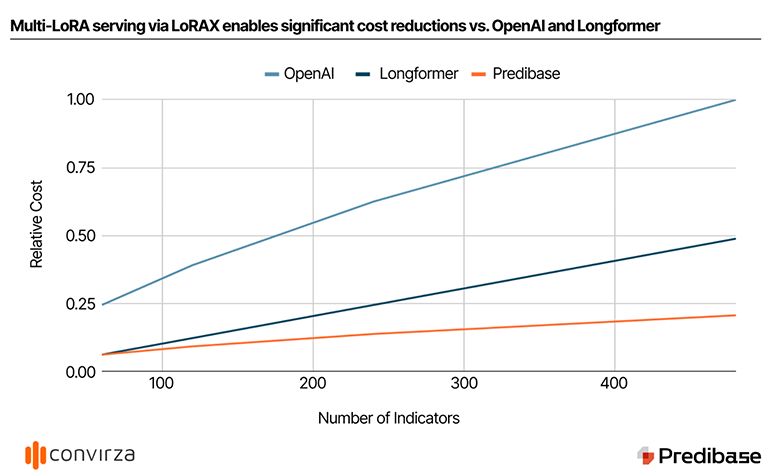

コール分析大手のConvirzaは、Predibaseのプラットフォームを活用し、エージェント評価の効率化と大幅なコスト削減を実現しました。

MetaのLlama 3 8Bをベースに、60の評価指標ごとに最適化されたLoRAアダプターを単一モデル上で運用。この結果、OpenAI比で運用コストを10分の1に削減、F1スコアは平均8%向上を達成しました。さらに、高負荷時でも平均応答時間2秒未満を実現しています。

この事例から、特定業務へのAI導入では、SLMの活用と先進的な運用基盤が極めて有効であることが伺えます。

参考: Convirza

HP製品との連携・相乗効果

HPは、ハードウェアとソフトウェアの両面から、SLMの活用を推進しています。ここでは、HPのノートPCやワークステーションが、どのようにSLMの性能を引き出し、ビジネスに貢献できるのかを解説します。これらの連携により、どのような相乗効果が生まれるのかを見ていきましょう。

HP ビジネスPC: SLMの安全かつ自在な活用を実現

HP ビジネスPCは、場所を選ばず、安全に、SLMを活用した業務を行える環境を提供します。

電波の届きにくい場所や機密情報を扱う場面でも、このPCなら安全なSLM活用が可能です。 HP独自のセキュリティ機能「HP Wolf Security」が、不正アクセスや情報漏洩のリスクを減らし、SLMを安心して運用できる環境を整えます。

HP EliteBook 1040 G11は、AI処理に最適化された最新のインテル® Core™ Ultra プロセッサーを選択でき、SLMを快適に動作させられます。また、最大約20時間のバッテリー駆動により、外出先でも電源を気にせずSLMを活用できます。さらに、このプロセッサーは電力効率にも優れており、省電力化にも貢献します。

HPのビジネスPCは、オフィスでも外出先でも、高度なセキュリティと優れた電力効率で、SLMを活用した業務の効率化を可能にし、よりスマートな働き方を実現します。

参考: 日本HP「HPビジネスPC」

モバイルワークステーションが実現する次世代のAIワークフロー

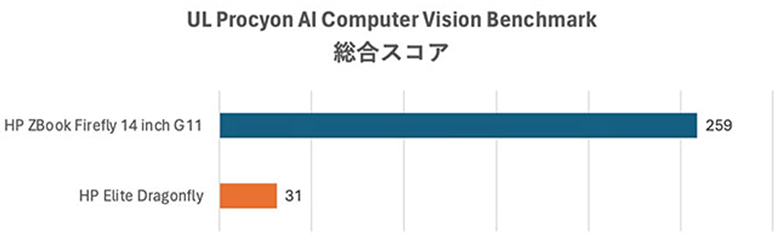

HP ZBook Firefly 14 inch G11は、SLMのオンデバイス運用に最適な高性能モバイルワークステーションです。

インテル® Core™ Ultra プロセッサーを搭載し、CPU・GPU・NPUを使い分けることで、効率的なAI処理を実現します。オンプレミスで機密データを扱い、迅速な開発を支援できます。

7年前のPCと比較してAI処理能力は8倍以上です。最大64GBメモリ、高精細な5MPカメラ、AIによるオートフレーミングやノイズリダクション機能を備え、公称約16時間53分のバッテリー駆動時間を誇ります。

HP ZBook Fireflyは、自社のデータセキュリティを守りながら、AI開発を加速させる強力なパートナーとなるでしょう。

参考: HP Tech&DeviceTV

Copilot+ PCへの対応

Microsoftが定義するCopilot+ PC要件を満たすHPの最新AI PC、たとえばHP EliteBook X G1a 14 AI Notebook PCは、高性能なNPUなどAI特化ハードウェアを搭載し、ローカルでSLMを高速に動かせる設計です。

従来のクラウド依存型AIと異なり、最大55TOPSのNPU性能を備えた AMD Ryzen™ AI プロセッサーによるオンデバイス処理で、ネットワーク環境の制約とセキュリティリスクを排除しています。これにより、場所を選ばず機密データを扱えます。

HP EliteBook X G1a 14 AI Notebook PCは、最大64GBのLPDDR5XメモリとCopilotキーを備え、Microsoft推奨SLM「Phi Silica」を高速で動かせます。ライブキャプションで44の言語をリアルタイム翻訳し、コクリエイターやHP AI Companionなども活用できます。

HP EliteBook X G1a 14 AI Notebook PCが、AIの力を最大限に引き出し、自社のビジネスを新たなステージへと導きます。

参考: HP Tech&DeviceTV

おわりに

SLMは大規模モデルに比べて軽量かつカスタマイズしやすく、様々な産業でその可能性が注目されています。HP製品との連携では、モバイル性や省電力性、セキュリティ性能を活かした、クラウドに依存しないエッジAIの実現が近づいています。ユーザーが選択できるソリューションは確実に増えていくでしょう。自社のビジネス課題を解決し、新たな価値を創造するために、SLMとHP製品の活用をぜひ検討してみてください。

HPは、ビジネスに Windows 11 Pro をお勧めします。

Windows 11 は、AIを活用するための理想的なプラットフォームを提供し、作業の迅速化や創造性の向上をサポートします。ユーザーは、 Windows 11 のCopilotや様々な機能を活用することで、アプリケーションやドキュメントを横断してワークフローを効率化し、生産性を高めることができます。

組織において Windows 11 を導入することで、セキュリティが強化され、生産性とコラボレーションが向上し、より直感的でパーソナライズされた体験が可能になります。セキュリティインシデントの削減、ワークフローとコラボレーションの加速、セキュリティチームとITチームの生産性向上などが期待できる Windows 11 へのアップグレードは、長期的に経済的な選択です。旧 Windows OSをご利用の場合は、AIの力を活用しビジネスをさらに前進させるために、Windows 11 の導入をご検討ください。

※このコンテンツには日本HPの公式見解を示さないものが一部含まれます。また、日本HPのサポート範囲に含まれない内容や、日本HPが推奨する使い方ではないケースが含まれている可能性があります。また、コンテンツ中の固有名詞は、一般に各社の商標または登録商標ですが、必ずしも「™」や「®」といった商標表示が付記されていません。